Episodio 4 — Quando SofIA ha iniziato a conoscere il prodotto

Con il function calling, SofIA era diventata un agente operativo dentro HOTELCUBE WOW.

L’utente faceva una richiesta, il modello la interpretava, il sistema eseguiva le operazioni necessarie e il risultato veniva restituito in forma naturale.

Sembrava un sistema completo.

Ma c’era ancora un limite evidente.

SofIA sapeva usare il prodotto. Non lo conosceva.

Il problema della conoscenza

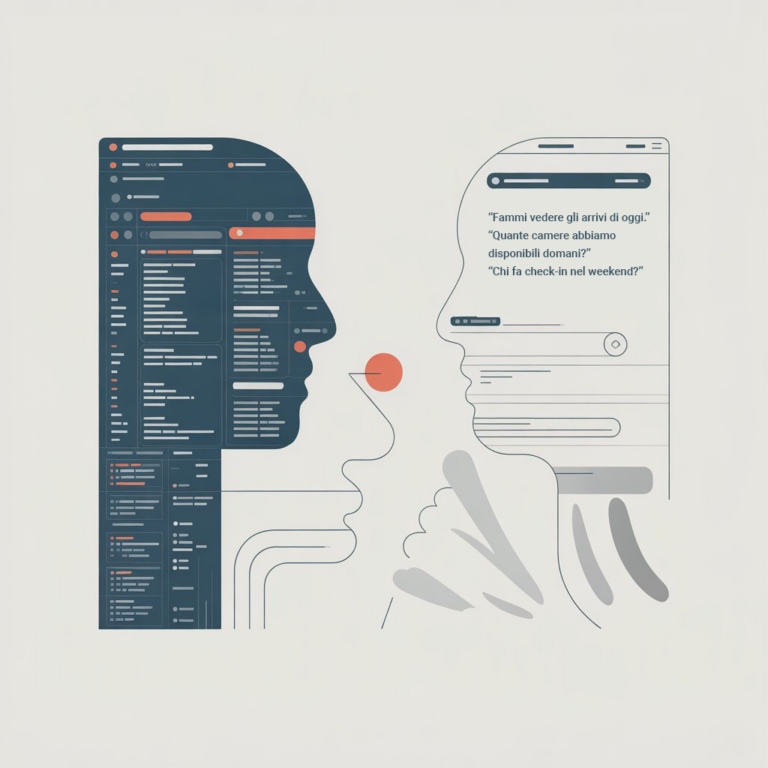

Un software come HOTELCUBE non è solo un insieme di funzionalità. È fatto di regole, logiche, casi particolari, documentazione accumulata nel tempo. E gli utenti non chiedono soltanto di eseguire operazioni.

Chiedono anche: “come funziona questa procedura?“, “perché il sistema si comporta così?“, “qual è il modo corretto per gestire questo caso?“

Sono domande a cui un modello linguistico generico non può rispondere in modo affidabile. Un Large Language Model conosce solo ciò che ha visto durante l’addestramento. Ma un PMS è un software in continua evoluzione: nuove funzionalità, nuove procedure, nuove configurazioni. Serve conoscenza specifica, aggiornata, del sistema reale.

Collegare l'AI alla documentazione

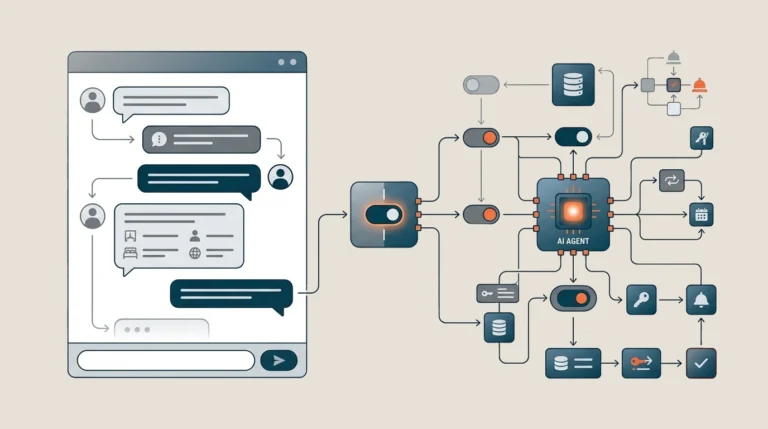

Per risolvere questo tipo di problema esiste un approccio ormai consolidato nel settore: il Retrieval-Augmented Generation, comunemente chiamato RAG.

L’idea di base è semplice. Invece di chiedere al modello di rispondere basandosi solo sulla sua “memoria”, il sistema recupera prima le informazioni rilevanti da una base di conoscenza, documentazione, guide, procedure, articoli tecnici, e le fornisce al modello come contesto nel momento della risposta.

In questo modo il modello può generare risposte basate sui contenuti reali del prodotto, non su quello che ha imparato durante l'addestramento.

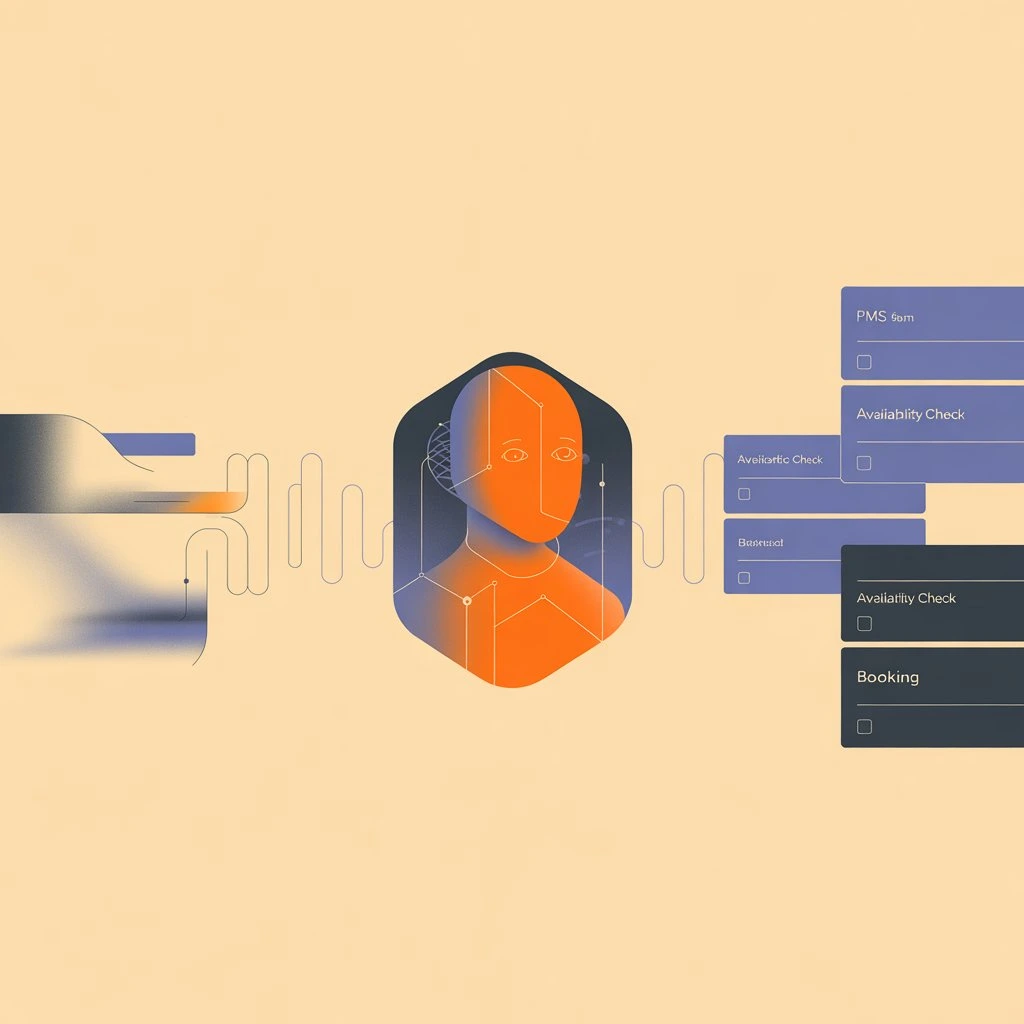

Una strada diversa dallo standard

Quando abbiamo iniziato a lavorare su questo problema, la direzione sembrava già tracciata: database vettoriali, embedding, pipeline di ricerca semantica. Era lo standard del settore.

Ma avevamo già qualcosa che lo standard non considerava: un sistema di documentazione strutturato, aggiornato e accessibile tramite API, già integrato nel prodotto.

Quindi ci siamo posti una domanda semplice: perché costruire qualcosa di nuovo invece di sfruttare quello che avevamo già?

SofIA Tech Note - RAG tradizionale vs approccio diretto

Nel RAG tradizionale, i documenti vengono trasformati in vettori numerici e archiviati in un database specializzato. Quando arriva una domanda, il sistema cerca i vettori più simili e recupera i testi corrispondenti. È un approccio potente, ma richiede infrastruttura dedicata e la duplicazione della documentazione originale.

Nel caso di SofIA, abbiamo seguito una strada diversa. Invece di costruire un database vettoriale, abbiamo fornito al modello un elenco degli argomenti documentati disponibili e lasciato che fosse l'AI stessa a decidere quale informazione recuperare. Quando l'utente fa una domanda, SofIA interpreta l'intento, capisce se si tratta di una richiesta operativa o documentale e decide quale chiave passare all'endpoint di help. Non cerca "testo simile": decide quale documento è rilevante. Il risultato è un'architettura più semplice, senza duplicazione dei dati e con documentazione sempre aggiornata.

Perché ha funzionato

I vantaggi di questo approccio sono stati immediati: la documentazione è sempre aggiornata, non esiste duplicazione dei dati, l’architettura è più semplice e la latenza è inferiore rispetto a una pipeline RAG tradizionale.

Il risultato più importante però è stato un altro.

SofIA non era più solo un sistema che eseguiva operazioni. Era diventata un intermediario intelligente tra l’utente e il sistema, capace di capire cosa serve in ogni momento e dove andare a cercarlo.

SofIA inizia a conoscere il suo mondo

Con questo passaggio, SofIA ha smesso di essere un agente che usa strumenti e ha iniziato a essere qualcosa di più completo: un sistema capace di capire richieste, usare strumenti, recuperare informazioni e adattarsi al contesto. Tutto attraverso una conversazione naturale, in un ambiente reale, con utenti reali.

Ed è stato in questo momento che qualcosa è diventato chiaro.

Il valore non era nel modello. Non era nella qualità delle singole risposte. Era in tutto quello che c’era intorno: architettura, integrazione, controllo, affidabilità.

SofIA aveva smesso di essere un'integrazione. Era diventata un sistema.

Un percorso che non è ancora finito

Quando abbiamo iniziato, non avevamo una roadmap. Non avevamo un progetto definito.

C’erano solo studio, esperimenti e molte domande senza risposta.

Con il tempo SofIA è cresciuta passo dopo passo: dal primo prototipo ai chatbot, dagli agenti fino a un assistente integrato nel prodotto, capace di interagire con gli utenti, utilizzare le funzioni del PMS e accedere alla conoscenza del sistema.

La cosa più interessante, però, è che questo percorso non è affatto concluso. Ogni nuova evoluzione dell’AI apre possibilità che pochi mesi prima sembravano fuori portata.

Quello che all’inizio era solo codice è diventato qualcosa di molto più grande.

E se SofIA potesse ricordare? È solo l’inizio.

Continua nell’Episodio 5 — La memoria

SofIA Tech Note

Questa sezione è pensata per chi vuole capire cosa c'è davvero "sotto il cofano".

Si può leggere per approfondire l’aspetto tecnico dietro SofIA...oppure no!

L’aspetto tecnico dietro questo episodio

- database aziendali

- documenti interni

- dati aggiornati

Un sistema RAG combina due componenti:

- recupero di informazioni esterne

- generazione di risposta tramite LLM

Quando arriva una domanda:

- il sistema cerca documenti rilevanti in una knowledge base

- questi documenti vengono forniti al modello come contesto

- il modello genera la risposta basandosi su queste informazioni

In un sistema RAG le informazioni sono distribuite:

LLM

- conoscenza generale

- pattern linguistici

- contenuti appresi nel training

Knowledge base esterna

- documenti

- database

- manuali

- FAQ

Il modello non memorizza questi dati nei propri pesi:

li utilizza al momento della risposta.

Il RAG permette di:

- usare informazioni aggiornate

- integrare documentazione aziendale

- ridurre allucinazioni

Un LLM da solo è potente.

Un LLM collegato ai dati reali di un sistema diventa uno strumento operativo.

RICEVI I NOSTRI UPDATE

SofIA è in continua evoluzione o come dicono i tech è under costruction!

Se però vuoi continuare a leggere i prossimi episodi e soprattutto i prossimi sviluppi, iscriviti alla nostra newsletter. Senza spam, solo sostanza.